具身智能工具

pxRobotLearning

pxRobotLearning是一个端到端的平台,用于开发、训练、验证和部署物理人工智能系统。它将仿真优先开发、数据收集、模仿学习、强化学习和优化推理整合到一个单一、连贯的流程中,可以从研究扩展到实际部署。

- 以仿真为中心的学习流程

- 灵活的学习算法

- 仿真到实际的适应与微调

- 生产就绪部署和多模式学习

我们提供什么

Isaac Sim 基于仿真的流程

- 高保真仿真基础

该学习流程基于 Isaac Sim 构建,为机器人交互和数据生成提供物理上逼真的环境。 - 可扩展的训练环境

支持大规模并行仿真,以实现高效的政策训练和评估 - 灵活的场景和传感器配置

支持快速设置机器人模型、传感器和任务场景

强化学习与模仿学习算法

- 多种强化学习算法选项

提供一系列适用于不同机器人任务的先进强化学习算法。 - 通过示范进行模仿学习

支持从通过远程操作或脚本策略收集的专家数据中进行学习 - 统一培训框架

允许在同一流程中无缝组合或切换强化学习 (RL) 和迭代学习 (IL) 方法。

多物理场仿真间传输

- 跨引擎验证

支持在 PhysX、Newton 和 MuJoCo 之间进行仿真间数据迁移,以提高泛化能力。 - 物理感知鲁棒性测试

政策会受到各种动态因素、联系和约束的影响。 - 降低模拟器偏差

缓解过度拟合单一物理引擎的问题

仿真到实际的微调

- 渐进式域适应

利用真实世界数据对在模拟环境中训练的策略进行微调 - 弥补现实差距

解决动力学、传感和驱动方面的差异 - 安全高效的部署

实现从仿真到物理机器人的逐步过渡

使用 ONNX 和 TensorRT 实现高性能部署

- 标准化模型导出

将训练好的模型转换为 ONNX 格式,以便进行与框架无关的部署。 - TensorRT优化推理

在边缘和嵌入式GPU上实现低延迟、高吞吐量的执行 - 可用于生产环境的运行时栈

专为稳定且可扩展的机器人部署而设计

视觉-语言模型与视觉-语言-动作学习

- 多模态感知与推理

整合视觉和语言理解能力以完成复杂任务 - 视觉-语言-行动(VLA)政策

使机器人能够将高级指令映射到低级动作 - 针对机器人领域的微调

将预训练的多模态模型适配到真实的机器人环境和任务中

机器人学习平台提供端到端的工作流程,将仿真、学习、适应和部署整合到一个统一的系统中。该平台结合了高保真仿真、灵活的学习算法、强大的仿真到实测迁移能力、可直接用于生产的部署方案以及先进的多模态学习功能,从而能够面向广泛的实际应用,实现智能机器人行为的可扩展和可靠开发。

pxPerception

pxPerception是一个高精度感知平台,适用于在复杂真实环境中运行的移动和工业机器人。它通过紧密集成的传感和感知流程提供强大的空间理解能力,即使在弱光、杂乱或动态场景等具有挑战性的条件下,也能实现可靠的定位、建图和交互。

pxPerception 的设计理念是先进行仿真验证,再从现实到虚拟的工作流程,它支持基于数字孪生的开发,并加速从感知研究到生产就绪系统的过渡。

- 面向移动和工业机器人及人形机器人的高精度感知解决方案

- 专为弱光、仓库和工业环境设计,具有强大的传感性能

- 实现高精度空间感知,用于导航、定位和交互

- 提供一个用于机器人感知集成和定制的开放式开发平台

- 支持基于数字孪生的仿真和合成数据生成

我们提供什么

激光雷达-惯性测量单元融合感知与定位

- 紧密耦合的激光雷达-惯性测量单元集成

IMU与LiDAR传感同步,在采集点云数据的同时提供运动和姿态信息。 - 感知运动的点云生成

惯性测量可补偿扫描过程中的运动畸变,从而提高动态运动下的数据质量 - 与基于点云的定位融合

将惯性约束与几何匹配相结合,可以提高定位的鲁棒性和精度。 - 在严苛条件下表现稳定

集成式设计提高了在快速运动、稀疏几何形状和部分退化环境下的可靠性。

CUDA加速的SLAM

- 基于 CUDA 的 GPU 加速

核心SLAM组件在GPU上并行处理,以实现密集点云的实时处理。 - 高性能扫描匹配和状态估计

加速的配准和估计使得大规模环境下的低延迟操作成为可能。 - 基于SDF的地图重建

支持用于密集三维映射和场景建模的TSDF和ESDF表示 - 用于规划和碰撞检查的地图

生成的地图可直接供下游规划和控制模块使用。

基于点云的检测与分割

- 基于点云的原生3D感知

感知直接作用于 3D 数据,不受光照和视觉外观的影响。 - 从检测到分割

提供目标检测、语义分割和实例级理解 - 几何和基于学习的方法

结合经典几何学和数据驱动模型,实现稳健的感知 - 对环境有丰富的语义理解

使机器人能够在复杂场景中识别障碍物、结构和功能区域

pxTeleopForceXR

- 具备力反馈功能的AR/VR远程操作 + 自定义视觉和力引导

- Factr/Robot 作为引导臂,Meta Quest 3 / Apple Vision Pro 作为 XR 设备

- 仿真中的数据集收集:Isaac Sim 用于第一阶段原型测试

- Isaac Lab 集成用于与人工纠正/干预进行培训

- ZeroMQ 和 DDS 中间件作为通信替代方案

要让带有力反馈的XR远程操作达到“正确”的手感,很少能一步到位——尤其是在任务、工具和原型硬件频繁变化的情况下。同时,视觉模仿学习和VLA方法需要涵盖多个任务的高质量数据集,而强化学习通常受益于人机交互修正,这种修正在训练过程中注入人类意图作为稳定信号。

PxForceXRTeleop通过集成AR/VR + 力反馈远程操作堆栈简化了这一流程,该堆栈具有自定义视觉和力引导功能。在操作员端,它支持以FACTR 为模板的引导臂设置,并且在需要更高保真度的力反馈时,还可以与机械臂配对作为触觉设备。

在第一阶段测试和快速迭代中,PxForceXRTeleop 利用NVIDIA Omniverse Isaac Sim来验证交互和指导,同时收集结构化演示以生成数据集。对于HIL-RL ,它以Isaac Lab为目标平台,支持人类能够高效地提供干预和纠正的训练工作流程。

通过ZeroMQ (高吞吐量流)和DDS 中间件(实时消息传递)保持集成的模块化和易于部署的特性,并提供可配置的运行时行为,用于扩展、过滤、安全限制、指导策略和触觉配置文件。

仿真工具

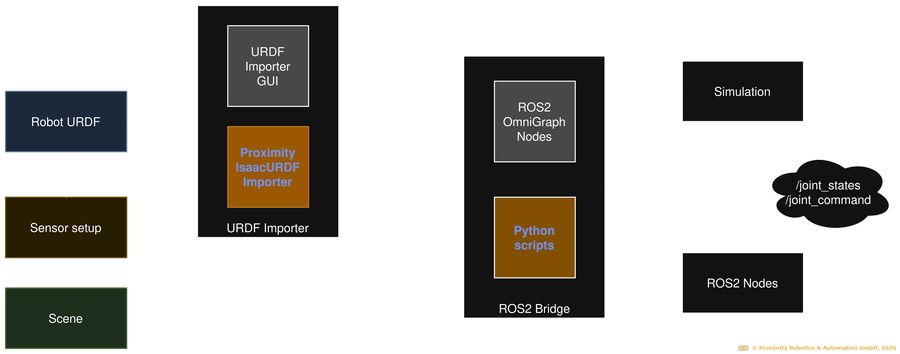

pxIsaacSimURDFImporter

将机器人引入仿真环境很少是一步到位的过程。尤其是在早期原型设计阶段,组件、传感器或运动结构频繁变化,维护一致的仿真模型很快就会变得既耗时又容易出错。

pxIsaacSimURDFImporter通过自动将机器人从其 URDF/xacro 描述导入 NVIDIA Omniverse Isaac Sim,简化了这一流程。工程师无需在每次迭代中手动调整资源,只需一条命令即可初始化完整的仿真场景,从而使设置过程更快、更易于复现。

- 直接从 URDF/xacro 文件将机器人导入 Isaac Sim

- 使用单个命令启动完整的模拟场景

- 集成了 ROS 就绪传感器、关节状态和 ros2_control

- 提供可扩展和可定制的开源架构

无缝URDF集成

将机器人从其 URDF/xacro 描述自动导入 Isaac Sim——以高保真度保留和扩展结构、参数和传感器配置。

ROS 2 原生兼容性

与现有的基于 ROS 的仿真和控制工作流程无缝集成。导入功能开箱即用,支持关节状态、传感器主题和 ROS 2 控制器。

灵活且可复制的原型制作

无需重复手动设置即可快速迭代。根据需要配置导入参数,并在每次构建时生成一致的、可用于仿真的环境。

pxIsaacSimURDFImporter是开源的,并且正在积极维护,持续开发以支持更新的 Isaac Sim 和 ROS 版本。

在GitHub 上探索源代码:PX_IsaacSim_URDF_Importer ,或者使用我们的Slamdog 3.0 迷你机器人和PX_IsaacSim_URDF_Importer_SLAMDOG3进行测试。

硬件

Slamdog 3.0 mini

Slamdog 3.0 mini是一款基于 ROS 2 的原生移动机器人,设计为模块化参考平台,适用于科研、教学和应用机器人开发。它采用模块化系统设计,可轻松适应不同的应用、传感器配置和硬件设置,同时保持仿真和实际硬件之间工作流程的可复现性。

Slamdog 3.0 mini 并非针对固定的应用,而是为在真实条件下验证算法、系统架构和机器人概念提供了一个灵活的基础。

主要特点

- 模块化建筑

- ROS 2 原生开源软件栈

- 全向驱动+差速驱动模拟器

- 支持仿真设计:完全支持开源的 NVIDIA Isaac Sim 模型

技术规格

- 尺寸(长x宽x高):400x400x334 毫米(含把手)

- 重量:约 20 公斤(含电池)

- 有效载荷:20公斤

- 最大速度:1.7 米/秒

硬件选项

- NVIDIA Jetson AGX作为板载控制器

直接在机器人上运行感知、机器人和基于学习的应用程序。 - 2D/3D激光雷达

Slamtec、Seyond、RoboSense - RGB-D相机

英特尔 RealSense D455/D455f

Stereolabs ZED系列 - 基于事件的摄像机

IDS uEye XCP-E (IMX636)

教学用例

- 开源的、ROS 2 原生平台——即刻可用!

- 完全集成的数字孪生

NVIDIA Omniverse Isaac Sim提供此功能,使学生能够从模拟开始,并无缝过渡到真正的硬件( github )。 - 提供自组装套件

支持系统集成、机械、电子和软件方面的实践学习。

节能机器人

- 集成能量测量(可选)

pxEMS可在实验和任务期间实时监测功耗。 - 节能意识教育

可用于教授能源分析、算法比较和节能系统设计。 - 研究就绪

支持在不同的硬件和软件配置下进行可重复的能量测量。

还在犹豫?

通过NVIDIA Omniverse Isaac Sim 集成体验 SLAMDOG 3.0 mini 的仿真功能: github - PX_IsaacSim_URDF_Importer_SLAMDOG3

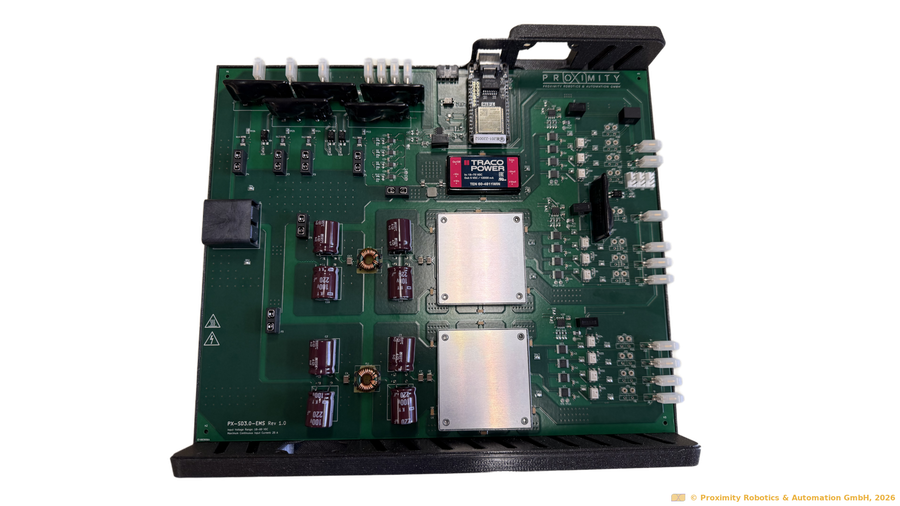

pxEMS

pxEMS是一款基于硬件的能源管理系统,旨在使机器人和物理人工智能系统中的能源消耗成为可测量、可控制和可优化的参数。

现代机器人集成了强大的计算能力、丰富的传感功能和复杂的执行机构,但往往无法清晰了解能源的实际消耗情况。pxEMS 通过高分辨率、多通道的能量监测和控制,使能量消耗可测量且可控,从而弥补了这一空白。该系统持续追踪多达 16 个独立通道的能量流动,详细洞察各个子系统在实际任务中的能耗情况,从而支持从仿真和概念验证到部署的节能开发。

pxEMS 完全集成到ROS 2 环境中,能够将能源效率与性能、安全性和可靠性一起考虑,从而支持可持续的、数据驱动的机器人技术。

主要特点

- 最多可设置 16 个通道,用于监测计算单元、传感器、执行器和子系统的功耗。

- 多种电压等级:电池电压、24V、12V 和 5V

- 通过 micro-ROS 无缝集成到 ROS2 环境中

典型应用案例

- 移动机器人、机械臂和人形机器人的能量分析

- 节能控制器和策略优化

- 数字孪生中能源模型的验证

- 以可持续发展为导向的自动化项目

- 研究和工业研发环境

应用领域

可持续性正成为现代机器人系统的一项关键要求。随着机器人集成越来越强大的计算、传感和执行功能,能源效率必须被视为核心设计参数,而非事后考虑的因素。

- 我们通过免费的pxEMS借用计划支持节能机器人领域的学术研究。详情请联系我们。

- 机器人和自动化公司可以使用 pxEMS 来验证可持续性声明并增加每次电池充电后的运行时间——联系我们了解更多信息。

pxSafeRemote

pxSafeRemote是一款经过安全认证的遥控器,专为机器人系统设计——当安全要求超过消费级控制器所能提供的范围时。

pxSafeRemote 完全集成于ROS 2中,可在满足紧急停止和控制信号的工业安全标准的同时,实现可靠的远程操作。它在实验系统和安全合规操作之间搭建了一座安全桥梁,确保早期自动化和机器人系统能够在不危及人员安全或违反合规性的情况下进行评估。

- 紧急停止和安全控制功能,最高可达 3 类,PL e / SIL 3

- 可靠的无线操作距离超过100米,适用于工业和户外环境

- ROS 2 原生集成

- 集成式 2.1 英寸图形显示屏和振动反馈,可清晰显示系统状态和警报

- 适用于安全需求变化速度快于系统自身变化速度的场景。

连接概念验证与安全合规

当出现安全要求时,可以继续进行测试和调试,而不会停止开发。

无需对“蓝牙游戏手柄”做出任何妥协

专为机器人项目而设计,在这些项目中,消费级控制器已不再适用。

适用于基于 Omniverse 和 ROS 2 的机器人的即插即用

可直接集成到现有的 Omniverse Simulation、ROS 2 控制和安全架构中。

有兴趣测试或将此遥控器集成到您的项目中吗?请联系我们了解更多信息。

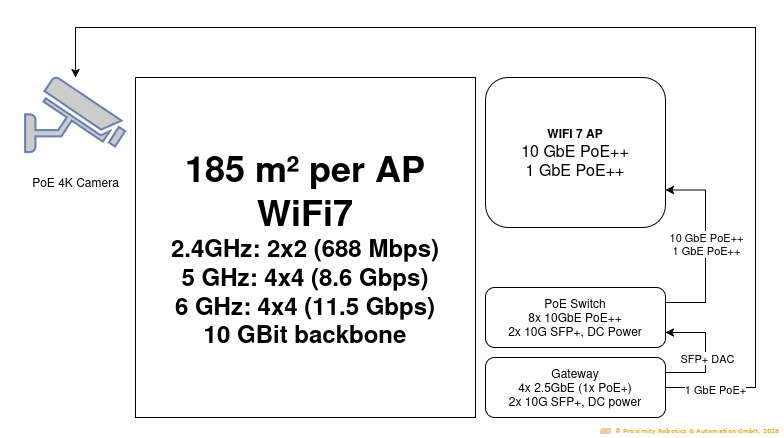

pxMobileNet

面向机器人演示和展览的高性能网络基础设施

pxMobileNet是一种便携式、预配置的网络基础设施,专为机器人演示、展览和短期部署而设计,适用于无线电环境拥挤、不可预测且充满敌意的场合。

展会和演示环境经常受到干扰、WiFi过载和连接不稳定等问题的困扰,这会使机器人演示面临风险。pxMobileNet 提供了一个可控的高性能通信骨干网,确保在最关键的时刻实现可靠运行。

可作为租赁服务或项目特定部署方式提供。

pxMobileNet包含哪些内容

- WiFi 7 接入点,具有高客户端容量和快速漫游功能

- 10GbE 骨干网,支持 PoE++,可为摄像头、AP 和边缘设备供电。

- 支持高带宽传感器(4K PoE 摄像头、激光雷达)

- 针对机器人工作负载的预配置QoS配置文件

- 针对 ROS 2 / DDS 流量优化的网关和交换基础设施

主要优势

- 在恶劣的射频环境下也能稳定运行

- 无需依赖场地WiFi

- 快速安装和拆卸

- 已知且经过测试的性能特征

- 减轻演示团队的压力

- 不间断、可持续的电力供应

可选附加组件

- 现场安装和支持

- 活动期间的射频和网络监控

- 与机器人和传感器系统的集成

- 私有地址和安全 VPN 远程访问

- 5G 连接

- 卫星互联网接入

- 人工智能赋能的监控与现场监测

- 适用于边缘设备的 M2.2230 WiFi7 模块(Jetson AGX)

数据集和开放研究资源

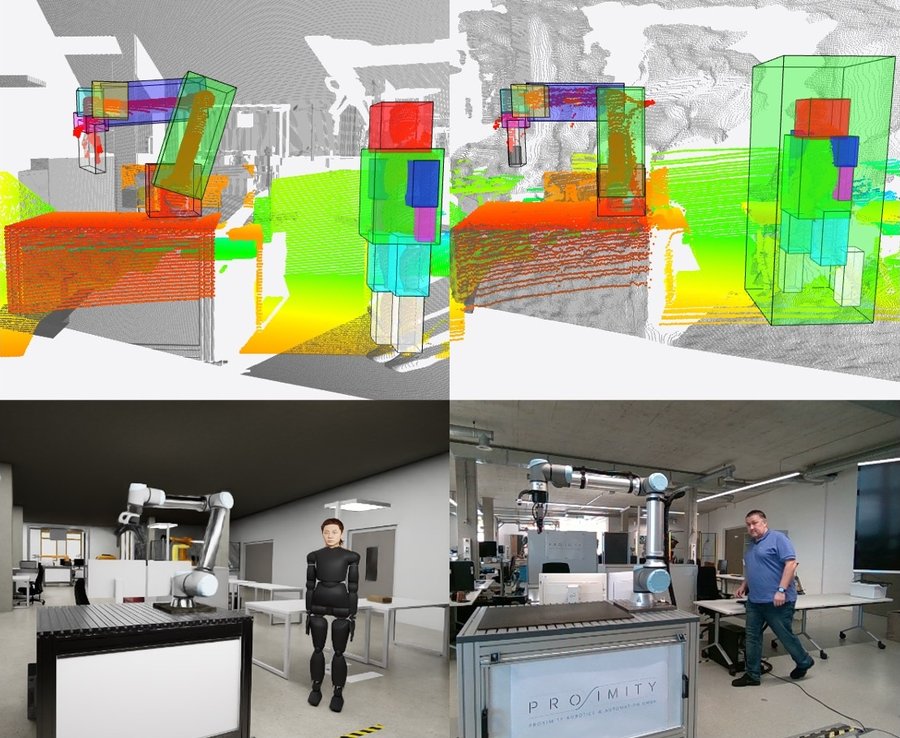

OmniABiD 数据集

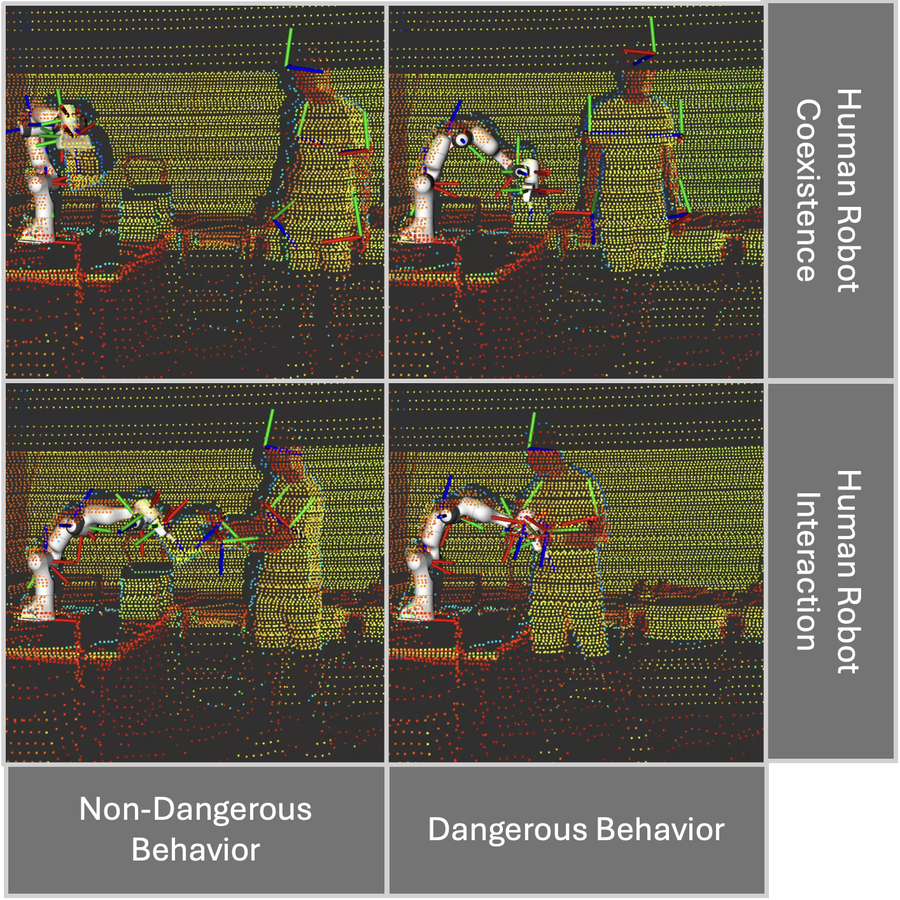

OmniABiD是一个开放数据集,旨在评估工业人机协作 (HRC)中的安全性和风险监控方法。它将高保真模拟场景(NVIDIA Omniverse Isaac Sim)与真实世界的记录相结合,从而能够在一致的交互环境中对模拟和现实中的算法进行系统比较。

- 在仿真和真实环境中开展工业人机交互场景评估,以验证仿真与真实环境的一致性。

- 重点关注协作/共存任务中的危害分析和风险监控

- 适用于对标风险指标和安全相关感知/监测管道

安全监测方法从仿真到实际迁移的基准测试

评估实际工业交互模式(交接/协作/共存)中的风险监控

用于安全感知和管道监控的训练/验证数据集

请查看我们的出版物:

- F. Plahl、G. Katranis、K. Alba、F. Wolny、S. Vock、A. Morozov 和 I. Mamaev,“OmniABiD:使用 NVIDIA Omniverse 评估人机协作安全性和风险监控中的 Sim2Real 可迁移性”,第 17 届欧洲机器人论坛 (ERF) 会议录,2026 年,即将发表。

了解更多关于我们通过CogniSafe3D项目在机器人安全方面所做的工作。

在 GitHub 上探索 OmniABiD: OmniABiD@github

LiHRA 数据集

LiHRA是一个开放数据集,用于人机交互(HRI)中的自动化风险监测,其核心是高分辨率3D激光雷达数据。它结合了3D点云、人体关键点和机器人关节状态,以支持实时风险检测和量化方法。该数据集包含4400多个带标签的帧,涵盖了有意接触和无意碰撞事件,从而能够在安全关键条件下进行评估。

- 以激光雷达为中心的风险监测数据集,包含对齐的人机状态信息

- 包括高分辨率点云、人体关键点和机器人关节状态

- 4400多帧带标签的图像,包含碰撞和接触场景

- 支持开发人工智能驱动的安全监控和主动风险评估方法

请查看我们的出版物:

- F. Plahl、G. Katranis、I. Mamaev 和 A. Morozov,“LiHRA:基于激光雷达的 HRI 数据集,用于自动化风险监控方法”,载于 IEEE/RSJ 国际智能机器人系统会议 (IROS) 会议录,2025 年。

- G. Katranis、F. Plahl、J. Grimstadt、I. Mamaev、S. Vock 和 A. Morozov,“使用基于启发式方法的人机协作动态风险评估”,载于第 35 届欧洲安全可靠性会议 (ESREL) 会议录,2025 年,第 1830-1837 页。

了解更多关于我们通过CogniSafe3D项目在机器人安全方面所做的工作。

在 GitHub 上探索 LiHRA: LiHRA@github