Physical AI Tooling

pxRobotLearning

pxRobotLearning ist eine End-to-End-Plattform für die Entwicklung, das Training, die Validierung und den produktiven Einsatz von Physical-AI-Systemen. Sie vereint simulationsbasierte Entwicklung, Datenerfassung, Imitation Learning, Reinforcement Learning und optimierte Inferenz in einer einzigen, kohärenten Pipeline, die von der Forschung bis zum realen Einsatz skalierbar ist.

- Simulationszentrierte Lernpipeline

- Flexible Lernalgorithmen

- Sim-to-Real-Adaptation & Feintuning

- Produktionsreife Bereitstellung & multimodales Lernen

Was wir liefern

Isaac-Sim-basierte Simulationspipeline

- Grundlage für hochpräzise Simulationen

Die Lernpipeline basiert auf Isaac Sim und bietet physikalisch realistische Umgebungen für die Roboterinteraktion und Datengenerierung - Skalierbare Trainingsumgebungen

Unterstützt groß angelegte parallele Simulationen für effizientes Training und die Evaluierung von Policies - Flexible Szenen- und Sensorkonfiguration

Ermöglicht die schnelle Einrichtung von Robotermodellen, Sensoren und Aufgabenszenarien

Algorithmen des Reinforcement Learning und des Imitation Learning

- Mehrere RL-Algorithmusoptionen

Bietet eine Auswahl modernster Reinforcement-Learning-Algorithmen, die für verschiedene Roboteraufgaben geeignet sind - Imitation Learning anhand von Demonstrationen

Unterstützt das Lernen aus Expertendaten, die über Teleoperation oder vorgegebene Policies erfasst wurden - Einheitliches Training-Framework

Ermöglicht die nahtlose Kombination oder den Wechsel zwischen RL- und IL-Methoden innerhalb derselben Pipeline

Multi-Physics Sim-to-Sim-Transfer

- Engine-übergreifende Validierung

Unterstützt den Sim-to-Sim-Transfer zwischen PhysX, Newton und MuJoCo zur Verbesserung der Generalisierung. - Physikbasierte Robustheitsprüfung

Setzt Policies variierenden Dynamiken, Kontakten und Randbedingungen aus - Reduzierte Simulatorverzerrung

Verhindert die Überanpassung an eine einzelne Physik-Engine

Sim-to-Real-Feinabstimmung

- Progressive Domänenanpassung

Feinabstimmung von in Simulationen trainierten Strategien mithilfe realer Daten - Schließen der Reality Gap

Behebt Diskrepanzen in Dynamik, Sensorik und Aktorik - Sicherer und effizienter Einsatz

Ermöglicht den schrittweisen Übergang von der Simulation zu physischen Robotern

Hochleistungsbereitstellung mit ONNX & TensorRT

- Standardisierter Modellexport

Konvertiert trainierte Modelle in ONNX für die frameworkunabhängige Bereitstellung - TensorRT-optimierte Inferenz

Ermöglicht latenzarme und hocheffiziente Ausführung auf Edge- und eingebetteten GPUs. - Produktionsreifer Laufzeit-Stack

Konzipiert für einen stabilen und skalierbaren Robotereinsatz

Vision-Language-Modelle und Vision-Language-Action-Lernen

- Multimodale Perzeption und Schlussfolgerung

Verbindet visuelle und sprachliche Verarbeitung zur Bewältigung komplexer Aufgaben - Vision-Language-Action(VLA)-Policies

Ermöglicht es Robotern, übergeordnete Anweisungen auf untergeordnete Aktionen abzubilden. - Feinabstimmung für Roboterdomänen

Passt vortrainierte multimodale Modelle an reale Roboterumgebungen und -aufgaben an.

Die Robot Learning Platform bietet einen durchgängigen Workflow, der Simulation, Lernen, Anpassung und Einsatz in einem einheitlichen System verbindet. Durch die Kombination von hochpräziser Simulation, flexiblen Lernalgorithmen, robustem Transfer von der Simulation in die Praxis und produktionsreifem Einsatz mit fortschrittlichen multimodalen Lernfunktionen ermöglicht die Plattform die skalierbare und zuverlässige Entwicklung intelligenter Roboterverhaltensweisen für ein breites Spektrum realer Anwendungen.

pxPerception

pxPerception ist eine hochpräzise Perzeptionsplattform für mobile und industrielle Roboter, die in komplexen, realen Umgebungen operieren. Sie bietet ein robustes räumliches Verständnis durch eng integrierte Sensor- und Perzeptionspipelines und ermöglicht so zuverlässige Lokalisierung, Kartierung und Interaktion selbst unter schwierigen Bedingungen wie schlechten Lichtverhältnissen, unübersichtlicher Umgebung oder dynamischen Szenen.

pxPerception wurde mit Blick auf simulationsbasierte Validierung und Real-to-Virtual-Workflows entwickelt und unterstützt die Entwicklung auf Basis digitaler Zwillinge. Dadurch wird der Übergang von der Perzeptionsforschung zu produktionsreifen Systemen beschleunigt.

- Hochpräzise Perzeptionslösung für mobile und industrielle, sowie humanoide Roboter

- Konzipiert für Umgebungen mit schwachen Lichtverhältnissen, Lagerhallen und Industrieanlagen mit robuster Sensorleistung

- Ermöglicht hochpräzise räumliche Perzeption für Navigation, Lokalisierung und Interaktion

- Bietet eine offene Entwicklungsplattform für die Integration und Individualisierung der Robotik-Perzeption

- Unterstützt digitale Zwillings-basierte Simulation und die Generierung synthetischer Daten

Was wir liefern

Integrierte LiDAR-IMU-Perzeption und -Lokalisierung

- Eng gekoppelte LiDAR-IMU-Integration

Die IMU ist mit der LiDAR-Sensorik synchronisiert, um neben der Punktwolkenerfassung auch Bewegungs- und Lageinformationen bereitzustellen. - Bewegungsabhängige Punktwolkengenerierung

Trägheitsmessungen kompensieren Bewegungsverzerrungen während des Scannens und verbessern so die Datenqualität bei dynamischer Bewegung. - Fusion mit punktwolkenbasierter Lokalisierung

Trägheitsbeschränkungen werden mit geometrischem Abgleich kombiniert, um die Robustheit und Genauigkeit der Lokalisierung zu verbessern. - Stabile Leistung auch unter schwierigen Bedingungen

Das integrierte Design verbessert die Zuverlässigkeit bei schnellen Bewegungen, spärlicher Geometrie und teilweise degenerierten Umgebungen.

CUDA-beschleunigtes SLAM

- CUDA-basierte GPU-Beschleunigung

Die Kernkomponenten von SLAM werden auf der GPU parallelisiert, um dichte Punktwolken in Echtzeit zu verarbeiten. - Hochleistungsfähiges Scan-Matching und Zustandsschätzung

Beschleunigte Registrierung und Schätzung ermöglichen einen Betrieb mit geringer Latenz in großflächigen Umgebungen - SDF-basierte Kartenrekonstruktion

Unterstützt TSDF- und ESDF-Darstellungen für dichte 3D-Kartierung und Szenenmodellierung - Kartierung für Planung und Kollisionsprüfung

Die generierten Karten können direkt von nachgelagerten Planungs- und Steuerungsmodulen verwendet werden.

Punktwolkenbasierte Erkennung und Segmentierung

- Native 3D-Perzeption von Punktwolken

Die Perzeption arbeitet direkt mit 3D-Daten, unabhängig von Beleuchtung und visuellem Erscheinungsbild. - Von der Erkennung zur Segmentierung

Bietet Objekterkennung, semantische Segmentierung und Instanzverständnis - Geometrische und lernbasierte Methoden

Kombiniert klassische Geometrie mit datengetriebenen Modellen für eine robuste Perzeption - Reichhaltiges semantisches Verständnis von Umgebungen

Ermöglicht es Robotern, Hindernisse, Strukturen und Funktionsbereiche in komplexen Szenen zu erkennen.

pxTeleopForceXR

- AR/VR-Teleoperation mit Force-Feedback und benutzerdefinierter visueller und haptischer Unterstützung

- Factr/Robot als Führungsgerät, Meta Quest 3 / Apple Vision Pro als XR-Gerät

- Datenerfassung in der Simulation: Isaac Sim für Prototypentests der ersten Phase

- Isaac-Lab-Integration für das Training mit menschlichen Korrekturen/Interventionen

- ZeroMQ- und DDS-Middleware als Kommunikationsalternative

Ein stimmiges Gefühl bei der XR-Teleoperation mit Force-Feedback lässt sich selten in einem einzigen Schritt erreichen – insbesondere bei häufig wechselnden Aufgaben, Werkzeugen und Prototypen-Hardware. Gleichzeitig benötigen visuelles Imitationslernen und VLA-Ansätze hochwertige Datensätze für vielfältige Aufgaben , während Reinforcement Learning oft von Human-in-the-Loop-Korrekturen profitiert, die menschliche Intentionen als stabilisierendes Signal während des Trainings einbeziehen.

PxForceXRTeleop vereinfacht diesen Prozess durch einen integrierten AR/VR- und Force-Feedback-Teleoperationsstack mit benutzerdefinierter visueller und haptischer Führung . Auf der Bedienerseite unterstützt es ein Leader-Arm -Setup – basierend auf FACTR – und kann zudem mit Roboterarmen als haptische Geräte gekoppelt werden, wenn höherauflösendes Kraftfeedback erforderlich ist.

Für die erste Testphase und schnelle Iterationen nutzt PxForceXRTeleop NVIDIA Omniverse Isaac Sim, um Interaktion und Führung zu validieren und gleichzeitig strukturierte Demonstrationen für die Datensatzgenerierung zu sammeln. Für HIL-RL zielt es auf Isaac Lab ab und ermöglicht so Trainingsabläufe, bei denen Menschen effizient eingreifen und Korrekturen vornehmen können.

Die Integration wird durch ZeroMQ (Streaming mit hohem Durchsatz) und DDS-Middleware (Echtzeit-Messaging) modular und einsatzfreundlich gestaltet, mit konfigurierbarem Laufzeitverhalten für Skalierung, Filterung, Sicherheitsgrenzen, Führungsstrategien und haptische Profile.

Simulation Tooling

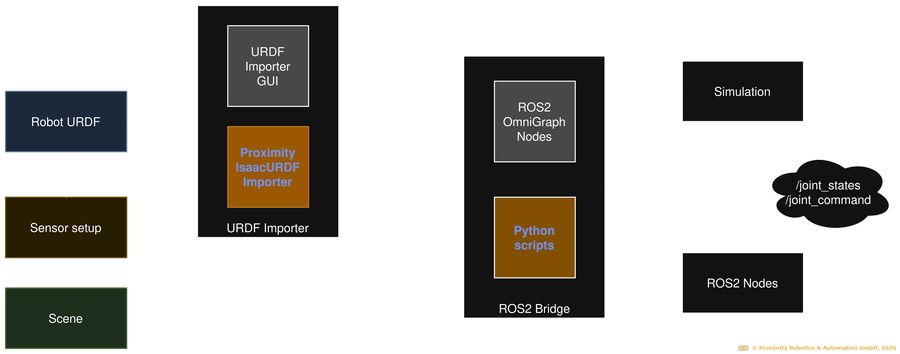

pxIsaacSimURDFImporter

Die Integration eines Roboters in eine Simulation ist selten ein einstufiger Prozess. Insbesondere in der frühen Prototypenphase, wenn sich Komponenten, Sensoren oder kinematische Strukturen häufig ändern, wird die Aufrechterhaltung eines konsistenten Simulationsmodells schnell zeitaufwändig und fehleranfällig.

Der pxIsaacSimURDFImporter vereinfacht diesen Prozess, indem er den Import von Robotern in NVIDIA Omniverse Isaac Sim direkt aus deren URDF/xacro-Beschreibungen automatisiert. Anstatt Assets für jede Iteration manuell anzupassen, können Entwickler eine komplette Simulationsszene mit einem einzigen Befehl initialisieren, was den Setup-Prozess beschleunigt und die Reproduzierbarkeit verbessert.

- Importiert Roboter direkt aus URDF/xacro-Dateien in Isaac Sim.

- Startet komplette Simulationsszenen mit einem einzigen Befehl

- Integriert ROS-fähige Sensoren, Joint States und ros2_control.

- Bietet eine erweiterbare und anpassbare Open-Source-Architektur

Nahtlose URDF-Integration

Automatischer Import von Robotern aus ihren URDF/xacro-Beschreibungen in Isaac Sim – unter Beibehaltung und Erweiterung von Struktur, Parametern und Sensorkonfigurationen mit hoher Genauigkeit.

ROS 2-native Kompatibilität

Lässt sich nahtlos in bestehende ROS-basierte Simulations- und Steuerungsworkflows integrieren. Der Import unterstützt standardmäßig Joint States, Sensor-Topics und ROS 2-Controller.

Flexibles und reproduzierbares Prototyping

Schnelle Iterationen ohne wiederholten manuellen Aufwand. Konfigurieren Sie Importparameter nach Bedarf und erzeugen Sie mit jedem Build konsistente, simulationsbereite Umgebungen.

Der pxIsaacSimURDFImporter ist Open Source und wird aktiv weiterentwickelt, mit laufender Unterstützung für neuere Versionen von Isaac Sim und ROS.

Erkunden Sie den Quellcode auf GitHub: PX_IsaacSim_URDF_Importer , oder testen Sie ihn mit unserem Slamdog 3.0 Mini- Roboter mit PX_IsaacSim_URDF_Importer_SLAMDOG3 .

Hardware

Slamdog 3.0 mini

Slamdog 3.0 mini ist ein ROS 2-nativer mobiler Roboter, der als modulare Referenzplattform für Forschung, Lehre und angewandte Robotikentwicklung konzipiert wurde. Dank seines modularen Aufbaus lässt er sich leicht an unterschiedliche Anwendungen, Sensorkonfigurationen und Hardware-Setups anpassen und gewährleistet gleichzeitig reproduzierbare Arbeitsabläufe zwischen Simulation und realer Hardware.

Anstatt auf eine feste Anwendung ausgerichtet zu sein, bietet Slamdog 3.0 mini eine flexible Grundlage für die Validierung von Algorithmen, Systemarchitekturen und Robotikkonzepten unter realistischen Bedingungen.

Hauptmerkmale

- Modulare Architektur

- ROS 2-nativer Open-Source-Software-Stack

- Omnidirektionalen Antrieb und Emulator für Differenzialantrieb

- Einsatzbereit für die Simulation: Voll unterstütztes Open-Source-Modell für NVIDIA Isaac Sim

Technische Daten

- Abmessungen (L x B x H): 400 x 400 x 334 mm (inkl. Griffe)

- Gewicht: ca. 20 kg (inkl. Batterie)

- Nutzlast: 20 kg

- Höchstgeschwindigkeit: 1,7 m/s

Hardwareoptionen

- NVIDIA Jetson AGX als Onboard-Controller

Führen Sie Perzeptions-, Robotik- und lernbasierte Anwendungen direkt auf dem Roboter aus. - 2D-/3D-LiDAR-Systeme

Slamtec, Seyond, RoboSense - RGB-D-Kameras

Intel RealSense D455 / D455f

Stereolabs ZED-Serie - Event-basierte Kameras

IDS uEye XCP-E (IMX636)

Ideal für die Lehre

- Open-Source-Plattform, ROS 2-nativ – sofort einsatzbereit!

- Vollständig integrierter digitaler Zwilling

Vom Start in der Simulation bis zur realen Hardware – mit NVIDIA Omniverse Isaac Sim können Studierende den gesamten Workflow durchlaufen und praxisnahe Kompetenzen erwerben. (github). - Als Selbstmontage-Kit erhältlich

Ermöglicht praxisnahes Lernen in den Bereichen Systemintegration, Mechanik, Elektronik und Software.

Energieoptimierte Robotik

- Integrierte Energiemessung (optional)

pxEMS ermöglicht die Echtzeitüberwachung des Stromverbrauchs während Experimenten und der Ausführung von Aufgaben. - Lehre mit Fokus auf Energieeffizienz

Fördert die Vermittlung von Methoden zur Energieanalyse, zum Vergleich von Algorithmen und zum energieeffizienten Systemdesign. - Bereit für die Forschung

Unterstützt reproduzierbare Energiemessungen über verschiedene Hardware- und Softwarekonfigurationen hinweg.

Noch nicht überzeugt?

Erleben Sie SLAMDOG 3.0 mini in der Simulation durch die NVIDIA Omniverse Isaac Sim-Integration : github - PX_IsaacSim_URDF_Importer_SLAMDOG3

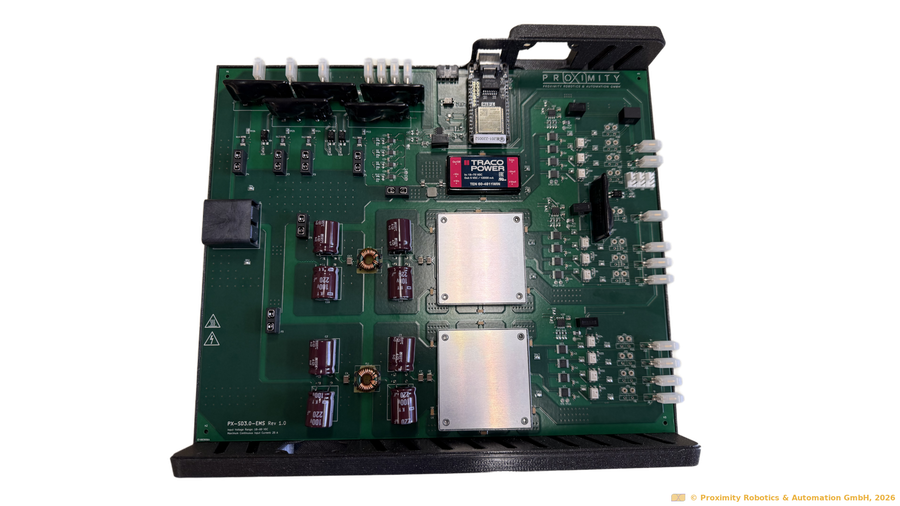

pxEMS

pxEMS ist ein hardwarebasiertes Energiemanagementsystem, das den Energieverbrauch in robotischen und Physical-AI-Systemen zu einem messbaren, steuerbaren und optimierbaren Parameter macht.

Moderne Roboter vereinen leistungsstarke Recheneinheiten, umfassende Sensorik und komplexe Aktorik – oft ohne klare Transparenz darüber, wo tatsächlich Energie verbraucht wird. pxEMS schließt diese Lücke, indem es den Energieverbrauch durch hochauflösende, mehrkanalige Energieüberwachung und -steuerung messbar und Handlungen möglich macht. Das System erfasst kontinuierlich die Energieflüsse über bis zu 16 unabhängige Kanäle und liefert detaillierte Einblicke in den Energieverbrauch einzelner Subsysteme während realer Aufgaben. So ermöglicht es eine energieoptimierte Systementwicklung von der Simulation und dem Machbarkeitsnachweis bis hin zum Einsatz.

Dank der nahtlosen Integration in ROS-2-Umgebungen ermöglicht pxEMS eine ganzheitliche Betrachtung des Systems und berücksichtigt dabei gleichzeitig Energieeffizienz, Leistung, Sicherheit und Zuverlässigkeit – und unterstützt so eine nachhaltige, datenbasierte Robotik.

Hauptmerkmale

- Bis zu 16 Kanäle zur Überwachung des Stromverbrauchs von Recheneinheiten, Sensoren, Aktoren und Subsystemen

- Mehrere Spannungsstufen: Batteriespannung, 24 V, 12 V und 5 V

- Nahtlose Integration in ROS-2-Umgebungen über micro-ROS

Typische Anwendungsfälle

- Energieanalyse von mobilen Robotern, Manipulatoren und humanoiden Robotern

- Energieoptimierte Steuerung und Policy-Optimierung

- Validierung von Energiemodellen in digitalen Zwillingen

- Nachhaltigkeitsorientierte Automatisierungsprojekte

- Forschung und industrielle F&E-Umgebungen

Anwendungsgebiete

Nachhaltigkeit wird zu einer zentralen Anforderung an moderne Robotersysteme. Da Roboter immer leistungsfähigere Rechen-, Sensor- und Aktoriksysteme integrieren, muss Energieeffizienz als zentrales Entwurfsmerkmal und nicht als nachgelagerter Aspekt betrachtet werden.

- Wir unterstützen die akademische Forschung im Bereich energieoptimierter Robotik durch ein kostenloses pxEMS-Leihprogramm . Kontaktieren Sie uns für weitere Informationen.

- Unternehmen aus den Bereichen Robotik und Automatisierung können pxEMS nutzen, um Nachhaltigkeitsversprechen zu untermauern und die Betriebszeit pro Batterieladung zu verlängern – kontaktieren Sie uns, um mehr zu erfahren.

pxSafeRemote

pxSafeRemote ist eine Safety-zertifizierte Fernbedienung für Robotersysteme für Einsatzszenarien mit erhöhten Sicherheitsanforderungen jenseits gängiger Consumer-Lösungen.

pxSafeRemote ist vollständig in ROS 2 integriert und ermöglicht einen zuverlässigen Betrieb über große Entfernungen unter Einhaltung der industriellen Sicherheitsstandards für Not-Aus- und Steuersignale . Es bildet eine sichere Brücke zwischen experimentellen Systemen und sicherheitskonformem Betrieb und gewährleistet so die Evaluierung von Automatisierungs- und Robotersystemen in frühen Entwicklungsstadien, ohne die Sicherheit des Personals oder die Einhaltung von Vorschriften zu gefährden.

- Not-Aus- und Sicherheitssteuerungsfunktionen bis Kategorie 3, PL e / SIL 3

- Zuverlässiger drahtloser Betrieb über 100 m, geeignet für industrielle Anwendungen und den Einsatz im Freien

- ROS 2-native Integration

- Integriertes 2,1-Zoll-Grafikdisplay und Vibrationsfeedback für klare Systemstatus- und Warnmeldungen

- Geeignet für Szenarien, in denen sich die Sicherheitsanforderungen schneller weiterentwickeln als das System selbst

Brücke zwischen PoC und Sicherheitskonformität

Ermöglicht kontinuierliche Tests und Inbetriebnahmen bei neu auftretenden Sicherheitsanforderungen – ohne Unterbrechung der Entwicklung.

Keine „Bluetooth-Joystick“-Kompromisse

Speziell entwickelt für Robotikprojekte, bei denen handelsübliche Controller nicht mehr akzeptabel sind.

Plug-and-Play für Omniverse- und ROS 2-basierte Roboter

Lässt sich direkt in bestehende Omniverse Simulations-, ROS 2 Steuerungs- und Sicherheitsarchitekturen integrieren.

Sie haben Interesse daran, diese Fernbedienung zu testen oder in Ihr Projekt zu integrieren? Kontaktieren Sie uns für weitere Informationen.

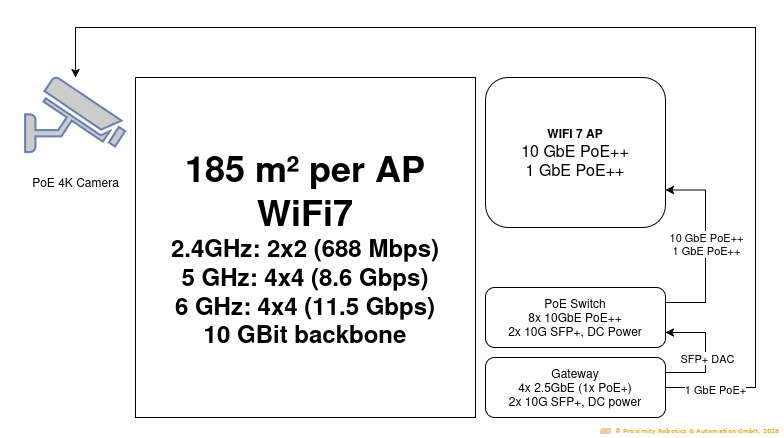

pxMobileNet

Hochleistungsfähige Netzwerkinfrastruktur für Robotik-Demos und -Ausstellungen

pxMobileNet ist eine portable, vorkonfigurierte Netzwerkinfrastruktur, die für Robotik-Demonstrationen, Ausstellungen und kurzfristige Einsätze in Umgebungen mit überfüllten, unvorhersehbaren und schwierigen Funkbedingungen entwickelt wurde.

Auf Messen und in Demo-Umgebungen kommt es häufig zu Störungen, überlastetem WLAN und instabilen Verbindungen – was Robotik-Demos gefährdet. pxMobileNet bietet ein kontrolliertes, leistungsstarkes Kommunikationsnetzwerk , das einen zuverlässigen Betrieb genau dann gewährleistet, wenn es darauf ankommt.

Verfügbar als Mietservice oder für projektspezifische Einsätze .

Was pxMobileNet beinhaltet

- WiFi 7-Zugangspunkte mit hoher Clientkapazität und schnellem Roaming

- 10-GbE-Backbone mit PoE++ für Kameras, Access Points und Edge-Geräte

- Unterstützung für Sensoren mit hoher Bandbreite (4K PoE-Kameras, LiDARs)

- Vorkonfigurierte QoS-Profile für Robotik-Workloads

- Gateway- und Switching-Infrastruktur optimiert für ROS 2 / DDS-Datenverkehr

Wichtigste Vorteile

- Robuster Betrieb in feindlichen HF-Umgebungen

- Keine Abhängigkeit vom WLAN des Veranstaltungsortes

- Schneller Auf- und Abbau

- Bekannte, geprüfte Leistungsmerkmale

- Weniger Stress für Demo-Teams

- Unterbrechungsfreie, nachhaltige Stromversorgung

Optionale Zusatzfunktionen

- Einrichtung und Unterstützung vor Ort

- HF- und Netzwerküberwachung während der Veranstaltung

- Integration mit Roboter- und Sensorsystemen

- Private Adressierung und sicherer VPN-Fernzugriff

- 5G-Konnektivität

- Satelliteninternetanschluss

- KI-gestützte Überwachung und Standortüberwachung

- M2.2230 WiFi7-Module für Edge-Geräte (Jetson AGX)

Datasets & Open Research Assets

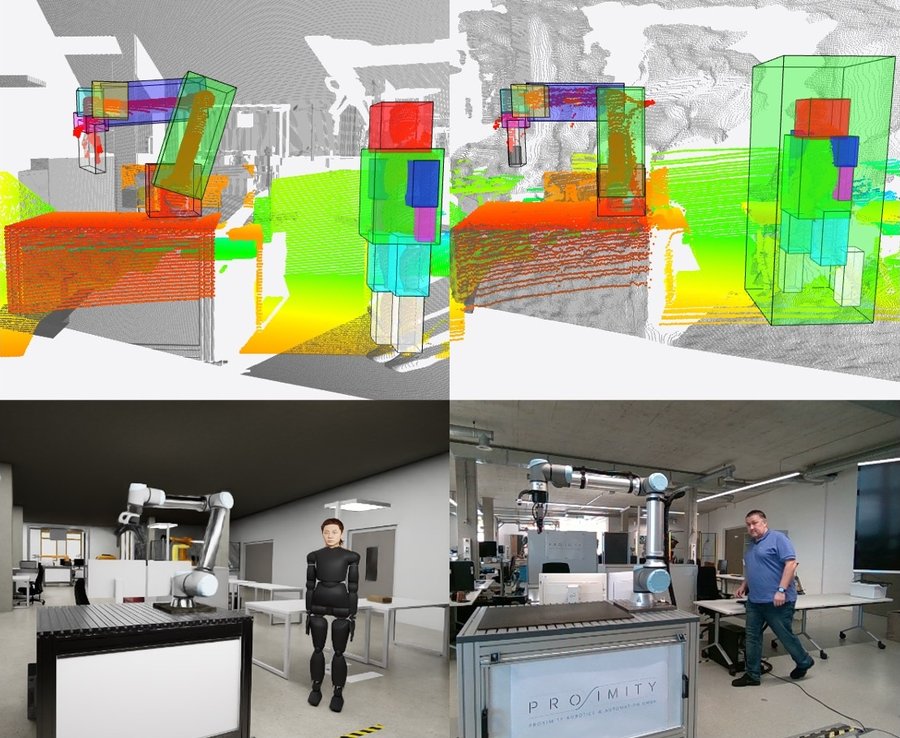

OmniABiD-Datensatz

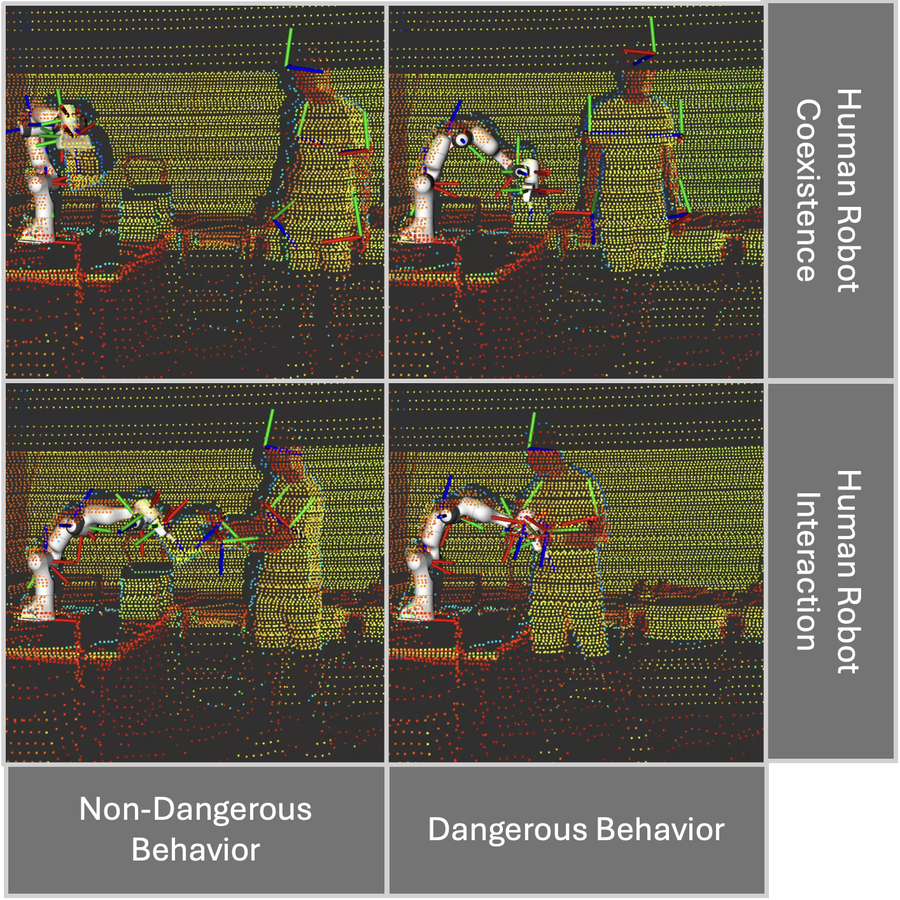

OmniABiD ist ein offener Datensatz zur Evaluierung von Sicherheits- und Risikoüberwachungsmethoden in der industriellen Mensch-Roboter-Kollaboration (MRK) . Er kombiniert hochpräzise simulierte Szenarien (NVIDIA Omniverse Isaac Sim) mit realen Aufnahmen und ermöglicht so einen systematischen Vergleich von Algorithmen in Simulation und Realität unter konsistenten Interaktionsbedingungen.

- Industrielle MRK-Szenarien in Simulation und realen Umgebungen für die Bewertung des Sim-to-Real-Transfers

- Schwerpunkt auf Gefahrenanalyse und Risikoüberwachung bei Kooperations-/Koexistenzaufgaben

- Geeignet für das Benchmarking von Risikokennzahlen und sicherheitsbezogenen Perzeptions-/Überwachungspipelines

Benchmarking des Sim-to-Real-Transfers von Sicherheitsüberwachungsmethoden

Bewertung des Risikomonitorings in realistischen industriellen Interaktionsmustern (Übergabe/Zusammenarbeit/Koexistenz)

Trainings-/Validierungsdatensätze für sicherheitsorientierte Perzeptions- und Monitoring-Pipelines

Werfen Sie einen Blick auf unsere Publikationen:

- F. Plahl, G. Katranis, K. Alba, F. Wolny, S. Vock, A. Morozov und I. Mamaev, „OmniABiD: Evaluating Sim2Real Transferability in Safety and Risk Monitoring of Human-Robot Collaboration using NVIDIA Omniverse“, in Proc. 17th Eur. Rob. Forum (ERF), 2026, erscheint demnächst.

Erfahren Sie mehr über unsere Arbeit zum Thema Sicherheit in der Robotik im Rahmen des Projekts CogniSafe3D .

Entdecken Sie OmniABiD auf GitHub: OmniABiD@github

LiHRA-Datensatz

LiHRA ist ein offener Datensatz für die automatisierte Risikoüberwachung in der Mensch-Roboter-Interaktion (MRI) basierend auf hochauflösendem 3D-LiDAR . Er kombiniert 3D-Punktwolken , menschliche Schlüsselpunkte und Gelenkzustände des Roboters zur Unterstützung von Verfahren zur Echtzeit-Risikoerkennung und -bewertung. Der Datensatz umfasst über 4.400 annotierte Bilder und beinhaltet sowohl beabsichtigte Kontakte als auch unbeabsichtigte Kollisionen, um eine Evaluierung unter sicherheitskritischen Bedingungen zu ermöglichen.

- LiDAR-zentrierter Datensatz für die Risikoüberwachung mit abgestimmten Zustandsinformationen von Mensch und Roboter

- Beinhaltet hochauflösende Punktwolken, menschliche Schlüsselpunkte und Gelenkzustände des Roboters

- Mehr als 4.400 beschriftete Frames mit Kollisions- und Kontaktszenarien

- Unterstützt die Entwicklung KI-gestützter Sicherheitsüberwachungs- und proaktiver Risikobewertungsmethoden

Werfen Sie einen Blick auf unsere Publikationen:

- F. Plahl, G. Katranis, I. Mamaev und A. Morozov, „LiHRA: Ein LiDAR-basierter HRI-Datensatz für automatisierte Risikoüberwachungsmethoden“, in Proc. IEEE/RSJ Int. Conf. Intell. Robots Syst. (IROS), 2025.

- G. Katranis, F. Plahl, J. Grimstadt, I. Mamaev, S. Vock und A. Morozov, „Dynamische Risikobewertung für die Mensch-Roboter-Kollaboration mittels eines heuristikbasierten Ansatzes“, in: Proc. 35th Eur. Saf. Reliab. Conf. (ESREL), 2025, S. 1830–1837.

Erfahren Sie mehr über unsere Arbeit zum Thema Sicherheit in der Robotik im Rahmen des Projekts CogniSafe3D .

Entdecken Sie LiHRA auf GitHub: LiHRA@github